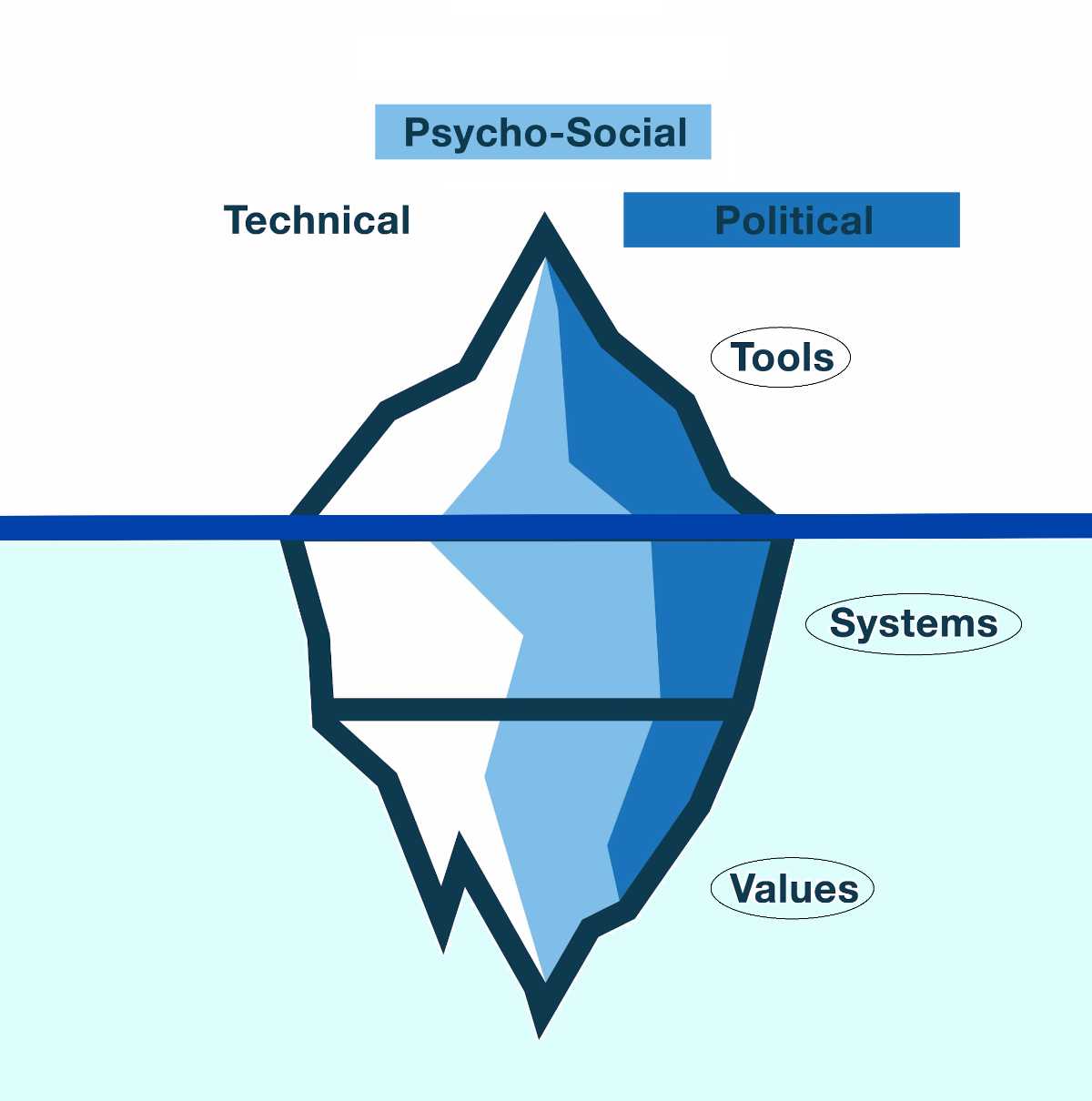

Kurz gesagt: KI kann heute Reime und Hooklines vorschlagen, Akkordfolgen und Melodien entwerfen, Beats generieren, Stimmen klonen und Mixing/Mastering automatisieren. Aus pädagogischer Sicht ist jedoch weniger der „Wow-Effekt“ der Tools relevant als die Beziehung, die wir – als Lehrkräfte und Lernende – zu dieser Technik gestalten. Bei der Reflexion dieser Beziehung bietet das Technology Education Eisberg-Modell Orientierung: Es unterscheidet im Kontext der Technologienutzung zwischen dem, was wir sofort hören und sehen (die Spitze), und dem, was das Ergebnis unsichtbar prägt (Unterwasser).

Technology Education Iceberg by Jacob Pleasants, Dan Krutka, & Phil Nichols

License: CC-BY-NC-4.0

Der Eisberg im Überblick

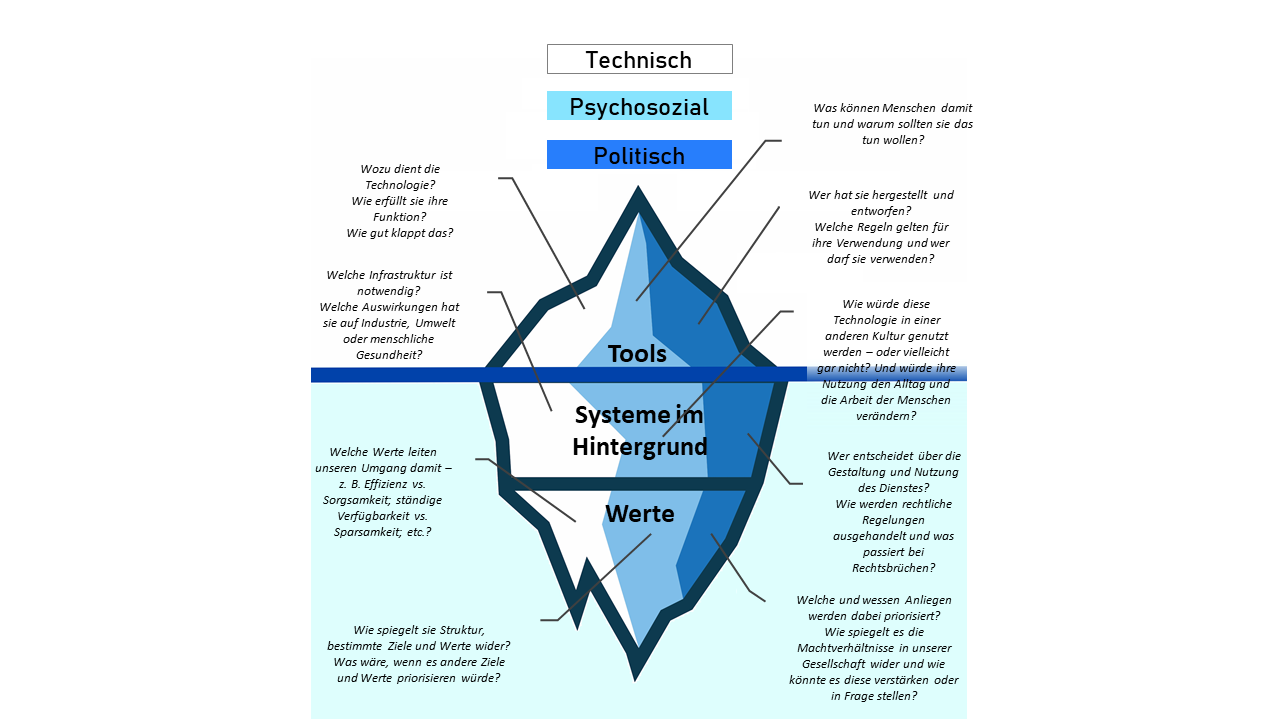

Das Modell wurde ursprünglich für die Reflexion über Technologienutzung in Bildungskontexten allgemein entwickelt. Das Modell besteht aus 3 x 3 unterschiedlichen Dimensionen und kann konkret von links nach rechts gelesen werden. Die drei unterschiedlichen Farbschattierungen stehen stellvertretend für die technische, psychosoziale und politische Dimension der genutzten Technologie. Die drei horizontalen Bereiche stehen für die sichtbare Ebene der Technologie als Werkzeug (Tools), die Ebene der eingebetteten und unsichtbaren informationstechnischen Systeme und die dritte Ebene steht für der Technologie zugrundeliegende Werte und Haltungen (Values).

Ebene 1: Tools (sichtbar)

Technisch: Auf dieser Ebene stehen Aufbau und Funktionsweise der eingesetzten Technologie im Vordergrund. Dazu geht es besonders darum, wozu ein bestimmtes Tool eingesetzt wird, wie es diese Funktion ausführt und wie gut es das leistet.

Psychosozial: Hier geht es darum, was die jeweilige Technologienutzung ermöglicht, welche Handlungen sie nahelegt und warum Menschen das wollen könnten – also die unmittelbare Wirkung auf Wahrnehmung, Handeln und Zusammenarbeit.

Politisch: Hier geht es darum, wer die Technologie entwickelt hat und wer über Gestaltung und Einsatz entscheidet. Ebenso wichtig sind die Regeln, die die Nutzung strukturieren (Zugriff, Grenzen, Verantwortungen).

Ebene 2: Systeme (unsichtbar eingebettet)

Technisch: Technologien sind meist in umfassende Infrastrukturen eingebettet (Netzwerke, Datenbanken, Clouds, ...). Daher geht es hier darum, wie diese Einbettung konkret gestaltet ist, wie sie betrieben/gewartet werden und welche Folgen sie für andere Systeme (z. B. Arbeitsabläufe, Umwelt, Gesundheit) haben.

Psychosozial: Wird eine bestimmte Technologie in fremde Kontexte eingeführt wie z.B. in den Fachunterricht, kann sie dort Praktiken verändern (z.B. Arbeitsweisen, Routinen, Organisation des Lernens und Zusammenarbeit). Hier wird danach gefragt, auf welche Weise und in welchem Umfang diese Veränderungen auftreten.

Politisch: Hier wird gefragt, wer Entscheidungen treffen darf und warum. Zu diesen Entscheidungen zählen formelle und informelle Regelwerke sowie die Frage, was geschieht, wenn Regeln gebrochen werden oder Gruppen ausgeschlossen bleiben.

Ebene 3: Werte (tief liegend, handlungsleitend)

Technisch: Technologien spiegeln Ziele und Normen des menschlichen Zusammenlebens. Ihre Einsatzbereiche, Wirkungsweisen und -kontexte zeigen, auf welchen grundlegenden Werten und Haltungen die Entwicklung und Nutzung erfolgt. Derartiges Nachdenken führt auch zu Fragen der alternativen Gestaltung und Nutzung (z.B. ausgerichtet auf Transparenz, Nachvollziehbarkeit, Ressourcenschonung).

Psychosozial: Technologie verstärkt oder untergräbt kulturelle Praktiken und soziale Werte. Gefragt wird deshalb, welche Formen von persönlichem Ausdruck, Identität, Zusammenarbeit und Anerkennung gestärkt werden – und welche vernachlässigt.

Politisch: Hier wird sichtbar, wie Technik Machtverhältnisse abbildet - wessen Anliegen sie priorisiert, wem sie Handlungsmacht gibt, wie Regeln entstehen und durchgesetzt werden und ob bestehende Verhältnisse weiter aufrechterhalten, stabilisiert oder herausgefordert werden.

Der Eisberg konkret auf KI-Dienste angewendet

Im Falle von KI-Diensten gelten die oben skizzierten Verflechtungen der Eisberg-Dimensionen in besonders verdichteter Form. Sichtbar ist zunächst die Tool-Ebene: Viele Angebote sind öffentlich zugänglich und wirken niedrigschwellig, zugleich hängen sie fast immer von einer stabilen, dauerhaften Internetverbindung ab. Zugänge sind häufig an Accounts, Nutzungsobergrenzen oder Bezahlmodelle gebunden; Funktionsumfang, Exportwege und Laufzeiten richten sich nach Plattformlogiken und können sich kurzfristig ändern. Für Unterricht bedeutet das: Das Greifbare an der Oberfläche – Bedienung, Schnelligkeit, unmittelbares Hören – steht von Beginn an in einer Abhängigkeit von Infrastruktur, Verfügbarkeit und Geschäftsbedingungen.

Unter der Oberfläche wirkt die System-Ebene. Hier bestimmen Datenquellen, Modellversionen, Update-Zyklen, Lizenz- und Datenschutzregelungen sowie die Einbettung in schulische IT-Strukturen, was möglich ist und was nicht. Änderungen am Modell können im Hintergrund den Sound und Ergebnisse unbemerkt und häufig über Nacht verändern; Zugriffsmöglichkeiten, Datenflüsse und Serverorte legen fest, wie Outputs weiterverarbeitet werden dürfen. Auch der Ressourcenbedarf – vom Netzwerk über Endgeräte bis zur Rechenleistung in der Cloud – ist Teil dieser Systemlogik. Da viele Dienste bislang nur vereinzelt in Unterrichtsszenarien erprobt sind, fehlen Routinen und rechtliche Regelungen; die Erprobung im Unterricht stellt damit eine pädagogische, organisatorische und häufig auch rechtliche Herausforderung dar.

Noch tiefer liegt die Werte-Ebene, die das Handeln auf einer basalen Ebene leitet. Hier werden Transparenz über Mitwirkung von Mensch und Maschine, Schutz von Stimme und Persönlichkeit, Fairness und Teilhabe, Rechtskonformität und ökologische Verantwortung verankert. Bezahlschranken und Kontenpflichten stellen Fragen der Zugänglichkeit; Plattformbindung und Abhängigkeiten stellen nicht selten die rechtliche Souveränität und pädagogische Integrität in Frage.

Zusammen genommen heißt das: Tools zeigen, was unmittelbar machbar ist, Systeme erklären, wodurch dieses was ermöglicht und begrenzt wird und Werte leiten, wie Technologien entwickelt und angewendet werden.

Weiterführende Impulse entlang des Eisbergmodells

Die folgenden, am Eisbergmodell orientierten Impulsfragen helfen Lehrkräften, Dienste und Anbieter für den Musikunterricht sachlich einzuordnen und auszuwählen. Zugleich dienen sie als Ausgangspunkt, Chancen, Grenzen und Rahmenbedingungen musikbezogener KI gemeinsam mit Lernenden zu reflektieren. Die Formulierungen sind bewusst offen gehalten und lassen sich je nach Schulform, Lerngruppe und Kontext anpassen oder erweitern.

Eisbergmodell deutsch nach Jacob Pleasants, Dan Krutka, & Phil Nichols

License: CC-BY-NC-4.0

Quellen und weiterführende Literatur:

- Pleasants, J., Krutka, D. G. & Nichols, P. Introducing the Technology Education Iceberg. https://www.civicsoftechnology.org/blog/introducing-the-technology-education-icerberg

- Krutka, D. G., Pleasants, J., & Nichols, T. P. (2023). Talking the technology talk. Phi Delta Kappan, 104(7), 42-46. https://drive.google.com/file/d/19-2gTiTEBaEUBkvunvm2JqKJeUOkFcPM/view

Lizenz: Die abgebildeten Logos sind von der CC-BY-SA-4.0 Lizenz ausgenommen.

Die Entwicklung und Erstellung dieser Materialien ist finanziert durch die Europäische Union – NextGenerationEU und gefördert durch das Bundesministerium für Bildung, Familie, Senioren, Frauen und Jugend. Weitere Informationen finden Sie unter lernen.digital. Die geäußerten Ansichten und Meinungen sind ausschließlich die der/des Autor:innen und spiegeln nicht unbedingt die Ansichten der Europäischen Union, Europäischen Kommission oder des Bundesministeriums für Bildung, Familie, Senioren, Frauen und Jugend wider. Weder Europäische Union, Europäische Kommission noch das Bundesministerium für Bildung, Familie, Senioren, Frauen und Jugend können für die Inhalte verantwortlich gemacht werden.

Die abgebildeten Logos sind von der CC-BY-SA-4.0 Lizenz ausgenommen.